| | CIBERNÉTICA |

“La cibernética es la teoría del mando, el control y

la comunicación en el animal y en la máquina” (Norbert Wiener)

“Las ideas básicas de la cibernética pueden tratarse

sin ninguna referencia a la electrónica y son fundamentalmente simples” (William Ross Ashby)

“La diversidad de la naturaleza puede ser explicada en el marco cibernético” (Heikki Hyötyniemi)

La Teoría Cibernética

El origen de una nueva ciencia

La palabra “cibernética” proviene de la palabra griega “kybernetes”, que significa “arte de gobernar o conducir un navío” como piloto o timonel. Del término griego procede la voz latina “gubernator”, con un significado similar. Platón utilizó este término en La República con el significado de “arte de gobernar”, y también como “arte de conducir a los hombres” y, en general, “arte de guiar”.

La palabra “cybernétique” también fue utilizada en 1834 por el físico André-Marie Ampère para referirse a las ciencias de gobierno (o arte de gobernar en política) en su famoso “Ensayo sobre la filosofía de las ciencias”, donde establecía un sistema de clasificación de los conocimientos humanos. “La futura ciencia de gobierno debería llamarse ‘la cybernétique’”.

En 1938, el matemático Louis Couffignal publicó un artículo pionero en la revista Europe donde especulaba sobre las posibilidades de las máquinas, capaces de tomar sus propias decisiones e incluso de reemplazar al hombre. También establecía analogías entre el sistema nervioso humano y la estructura interna de las máquinas.

La cibernética como ciencia arranca en 1948 con la publicación de la obra del matemático Norbert Wiener “Cibernética: o Control y Comunicaciones en el Animal y la Máquina”. Esta obra se convirtió en un best seller e inició uno de los movimientos científicos más espectaculares e influyentes. Wiener es considerado el padre de la cibernética.

La cibernética de Wiener es una abstracción inspirada en los problemas prácticos planteados durante la II Guerra Mundial, en concreto la necesidad de desarrollar mecanismos de control automático para los equipos militares de defensa antiaérea. Wiener construyó una teoría general de los sistemas de organización y control, con el concepto de retroalimentación (asociado a la consecución de un objetivo) como su fundamento más importante, concepto de tipo general también presente en la naturaleza, en los seres vivientes y en los sistemas sociales.

Las definiciones

Existen muchas definiciones de la cibernética:

- “Todo el campo de la teoría del mando y de la comunicación, tanto en la máquina como en el animal”. Esta era la definición original de Wiener, que posteriormente amplió a otros campos, especialmente al de las ciencias humanas.

- El estudio interdisciplinario de los sistemas autorregulados basados en la retroalimentación y en la interacción con el entorno.

- El estudio de los sistemas de comunicación y control en las máquinas, las organizaciones y los organismos vivos.

- El estudio de los sistemas teleológicos (del griego “telos”, meta u objetivo).

- “La rama de las matemáticas que se encarga de los problemas de control, recursividad e información” (Gregory Bateson).

- “El estudio de las relaciones de organización que deben tener los componentes de un sistema para existir como una entidad autónoma” (Heinz von Foester)

- “La ciencia de la organización efectiva” (Anthony Stafford Beer, experto en teoría de la organización).

- “El arte de asegurar la eficacia de la acción” (Louis Couffignal).

- “El estudio de sistemas y procesos que interaccionan consigo mismos y se producen a sí mismos de sí mismos” (Louis Kauffman).

- “La ciencia que estudia los principios abstractos de las organizaciones en sistemas complejos” (Francis Heylighen & Cliff Joslyn).

- “Una familia de enfoques para estudiar los sistemas complejos” (Heikki Hyötyniemi).

- La ciencia general de los organismos, sean naturales o artificiales.

- Un modelo abstracto de un ser vivo, o el arte de imitar a un ser vivo.

De todas estas definiciones, extraemos 3 conceptos fundamentales, que corresponden a características universales de muchos sistemas, incluidos los naturales:

- La retroalimentación (feedback), también denominada “retroacción” y “realimentación”, basada en la interacción de un sistema con el entorno.

- La teleología: la orientación de un sistema a la consecución de un cierto objetivo.

- La autorregulación: la capacidad de un sistema de controlarse a sí mismo, de forma autónoma para conseguir su objetivo.

La retroalimentación

Cuado el entorno de un sistema cambia, el sistema cambia para adaptarse a las nuevas condiciones de dicho entorno, siempre orientado a la consecución de un objetivo.

En la retroalimentación, la salida (o parte de ella) producida por un sistema se convierte en entrada. Se produce lo que se denomina un “lazo de retorno”. Según Norbert Wiener, “Retroalimentación es un método de control de un sistema por el que se reinsertan en él los resultados de su ejecución pasada”. La retroalimentación se considera “el secreto” de la naturaleza.

Hay que diferenciar entre proceso lineal y proceso con lazo de retorno:

- En el proceso lineal, el sistema actúa de forma fija, sin posibilidad de adaptación a las circunstancias cambiantes del entorno. Ejemplos: 1) un programa de ordenador que actúa basado únicamente en los datos de entrada; 2) la dictadura es un mecanismo sin lazo de retorno.

- En el proceso con lazo de retorno (o cíclico), el sistema tiene en cuenta el entorno y modifica su comportamiento. Ejemplos: 1) la democracia es un sistema con lazo de retorno constituido por la práctica del voto y la expresión de la opinión pública; 2) los sistemas interpersonales, que pueden entenderse como circuitos de retroalimentación, ya que la conducta de cada persona afecta a las otras y a su vez su conducta es afectada por las otras.

Hay varios tipos de retroalimentación. Las más destacadas son la retroalimentación negativa, la positiva y la compensada:

- En la retroalimentación negativa, una variación de la magnitud de salida ocasiona en el proceso siguiente una nueva variación en sentido contrario de esa magnitud de salida. Esta retroalimentación produce convergencia, acercando el sistema hacia el objetivo, hacia un estado final estable. Por ejemplo, un proyectil que puede rectificar su propia trayectoria en función de la información de localización de un objetivo móvil para conseguir su objetivo.

- En la retroalimentación positiva, una variación de la magnitud de salida ocasiona en el proceso siguiente una nueva variación en el mismo sentido de esa magnitud de salida. Esta retroalimentación produce divergencia, alejando al sistema del objetivo que es un estado final estable. Ejemplos en la naturaleza: incendios forestales, crecimiento de bacterias en un cierto entorno, una bola de nieve rodando por una pendiente, las reacciones nucleares en cadena, etc. Un ejemplo de tipo psicológico es: Pepe fuma cuando está nervioso; se preocupa por los efectos de fumar sobre su salud, lo que le hace ponerse más nervioso y fumar más; se entra en una “espiral viciosa”. Un ejemplo de tipo físico es el fenómeno de acoplamiento acústico (o efecto Larsen): cuando el sonido reproducido por los altavoces es captado de nuevo por el micrófono para ser amplificado nuevamente, produciéndose el conocido chillido. Un ejemplo de tipo político es la carrera armamentística. El desarrollo en espiral es otro ejemplo de realimentación positiva [ver Apéndice – Desarrollo en Espiral].

La retroalimentación positiva no crece o diverge indefinidamente. Al final hay una limitación impuesta por el entorno (los recursos disponibles) y la subsiguiente aparición de la retroalimentación negativa. Por ejemplo, unos conejos que se reproducen y comen hierba; cuanto más se reproducen hay menos hierba por cabeza; al final la limitación de la hierba disponible hace que se reproduzcan menos.

- En la retroalimentación compensada, el regulador realiza retroalimentaciones positivas o negativas, según las circunstancias, para mantener estable el sistema. Por ejemplo, un termostato, un frigorífico o un sistema de aire acondicionado, que requieren mantener estable una temperatura dentro de unos límites.

Teleología

Los sistemas deterministas están definidos a partir de las condiciones iniciales. Los sistemas teleológicos están condicionados a la consecución de un objetivo o a la obtención de un resultado final. Estas condiciones (iniciales o finales, respectivamente) influyen sobre los estados intermedios.

- Los sistemas físicos tienden a ser deterministas.

- Los sistemas biológicos tienden a ser teleológicos.

- A nivel psicológico (según Paul Watzlawick) el psicoanálisis freudiano pertenece a la escuela determinista. La psicología analítica de Jung se basa en gran medida en la asunción de un principio teleológico inmanente en el ser humano.

Cuando está definido el objetivo, hay “equifinalidad”, es decir, diferentes estados iniciales conducen al mismo estado final. El estado final también se le denomina “atractor”.

Cuando un sistema está en equilibrio, su objetivo es mantenerlo, por lo que el sistema retorna a dicho estado tras una perturbación interna o externa.

En sistemas cibernéticos complejos (como organismos u organizaciones) los objetivos se presentan como una jerarquía. Hay un objetivo principal o esencial (como la supervivencia) y objetivos subsidiarios o secundarios, donde un objetivo de un nivel controla a otros del nivel inmediato inferior. Un ejemplo simple es el de una habitación regulada por un termostato con un sensor de infrarrojos que detecta la presencia o no de personas, siendo su objetivo el ahorrar energía.

La autorregulación

El estado de un sistema cibernético está definido mediante una serie de parámetros esenciales. Para conseguir su objetivo, un sistema cibernético se autorregula, es decir, utiliza un mecanismo interno de control (llamado también regulador, controlador, sistema regulador o sistema de control) para adaptarse a las condiciones y perturbaciones del entorno, cambiando sus parámetros esenciales. La autorregulación implica autonomía. La naturaleza es el sistema cibernético más extraordinario, pues siempre se autorregula.

Existen 3 mecanismos de control:

- Buffering (amortiguación).

La amortiguación es la absorción pasiva de perturbaciones. Por ejemplo, en una habitación controlada por un termostato, una pared hace de amortiguador frente a los cambios de temperatura del exterior.

- Feedback (retroalimentación).

En la retroalimentación hay un regulador que maneja las perturbaciones después de que afecte a los parámetros esenciales del sistema. Tiene la ventaja de que es más fácil de implementar, pero tiene la desventaja de que debe permitir una desviación antes de adoptar una acción.

- Feedforward (alimentación directa).

En la alimentación directa hay un regulador que maneja las perturbaciones antes de que afecte a los parámetros esenciales del sistema. Por ejemplo, una habitación controlada por un termostato, con un sensor fuera de la habitación que avisa al termostato sobre variaciones de la temperatura exterior para que adopte una decisión antes de que afecte al interior de la habitación. Este sistema de control tiene la ventaja de la anticipación, pero la desventaja de que suele ser difícil de implementar en la práctica. No obstante, este sistema se hace necesario cuando las perturbaciones ocurren tan rápidamente que una reacción tipo feedback vendría demasiado tarde.

La presencia de control en un sistema cibernético significa que el sistema se puede concebir como dos unidades interactuantes: el controlador y lo controlado. En un sistema feedforward, el controlador recibe la señal de entrada del entorno y pasa una señal de control al sistema controlado. En un sistema feedback, el sistema controlado recibe la señal del entorno y pasa la misma señal al controlador, que devuelve una señal de control al sistema controlado.

Para Wiener, todo ser (biológico, artificial o mecánico) puede definirse por la naturaleza de los intercambios de información con el entorno. El propósito de la cibernética es comprender los comportamientos de información. La comunicación se concibe como intercambio de información con el entorno. La verdadera naturaleza de todo ser se encuentra en sus relaciones de comunicación. La comunicación cibernética es concebida como el comportamiento de intercambios de información.

Homeostasis

A Walter Cannon se debe el concepto de homeostasis (del griego “homo”, análogo y “estasis”, estabilidad). Este concepto data de 1939, anterior a la obra de Wiener. Es la característica de un sistema que se autorregula internamente para mantener su estabilidad (dentro de ciertos límites) frente a perturbaciones externas (del entorno) o internas. Este concepto es genérico y se aplica, no solo a sistemas cibernéticos, sino también a la biología (organismos vivos), psicología, sociología, etc.

- Homeostasis cibernética. En 1951, William Ross Ashby diseñó un mecanismo que denominó precisamente “homeostato” o “máquina homeostática”, que mostraba un comportamiento ultraestable frente a la perturbación de sus parámetros esenciales. Sus ideas las reflejó en su obra “Design for a Brain” (Proyecto para un Cerebro).

- Homeostasis biológica. Los seres vivos tienden hacia el equilibrio. Los componentes de un sistema biológico están en constante cambio para mantener dentro de ciertos límites (el espectro) el resultado del conjunto. Una enfermedad es un estado que requiere un aporte extra de energía para alcanzar el equilibrio.

- Homeostasis social. Las sociedades tienden a la estabilidad gracias a las normas, costumbres, tradiciones y hábitos.

- Homeostasis psicológica. A nivel individual, con nuestra conducta, buscamos el equilibrio entre nuestros deseos y necesidades y su consecución.

Entropía. La visión termodinámica de la cibernética

El marco más universal que gobierna todos los sistemas físicos es la termodinámica. Y esta ciencia tiene dos leyes. La primera ley de la termodinámica es el principio de conservación de la energía en un sistema aislado. La segunda ley afirma que la entropía siempre aumenta. La concepción tradicional de la entropía es que es una medida del nivel de desorden de un sistema. A mayor desorden, mayor es la entropía. El concepto inverso de entropía es la neguentropía, que es una medida del orden. Por lo tanto, según la segunda ley, todo sistema tiende hacia una mayor desorganización, hacia un menor orden, la entropía aumenta y la neguentropía disminuye.

La entropía es un concepto introducido por Rudolf Clausius en los años 1850s y formalizado posteriormente a nivel matemático por Ludwig Boltzmann, relacionándolo con la probabilidad. La palabra “entropía” procede del griego y significa “transformación”.

Todos los sistemas, incluso los cibernéticos, están gobernados por la ley de entropía: todo sistema “persigue” siempre aumentar su entropía y además lo hace a la máxima velocidad posible.

Hay diferentes interpretaciones de la ley de entropía, según el sistema que se considere:

- Los sistema termodinámicos evolucionan hacia los estados más probables, que son los más homogéneos.

- Los sistemas de información evolucionan hacia los estados de menos información.

- Los sistemas cibernéticos, incluidos los biológicos se “alimentan” de información y produce menos información.

El objetivo de un sistema cibernético es un estado de equilibrio, que es un estado de máxima probabilidad y mínima información. Cuando el sistema se desvía del estado de equilibrio, la desviación producida es información. Cuanto mejor y más eficiente el sistema de control (que hace recuperar el equilibrio del sistema), mayor es su variación de entropía por unidad de tiempo.

Se suele afirmar que en el mundo físico siempre aumenta la entropía (el desorden) y que en los sistemas biológicos aumenta la neguentropía (el orden). Pero no es cierto: en ambos casos se persigue el estado de equilibrio, el estado más probable, el de menor información. Por lo tanto, no hay que asociar entropía con desorden, sino con máxima probabilidad y mínima información. Podemos decir que la entropía es lo opuesto a información: cuanto mayor es la entropía, menor es la información.

Otras características de los sistemas cibernéticos

- Dimensión.

La dimensión de un sistema cibernético es el número de de parámetros esenciales e independientes que caracterizan su estado interno. Son sus grados de libertad.

- Espacio de estados.

Es el conjunto de estados posibles de un sistema (determinado por los valores que puede tomar cada parámetro esencial).

- Señales.

Las señales son comunicaciones entre los elementos de un sistema (señales internas) o entre el sistema y el entorno (señales externas). Estas señales pueden ser de tipo analógico o digital. Estas últimas son informaciones o mensajes. Si todas las señales son continuas, entonces el sistema se denomina “continuo”. Si todas son discretas, el sistema se denomina “discreto”. Puede haber sistemas mixtos. Un ejemplo de señal analógica es la intensidad de luz o de sonido. Una señal digital es una orden de encender o apagar una luz. Cuando el incremento entre valores discretos es muy pequeño, se puede considerar que la señal es continua. Respecto al tiempo, una señal puede ser continua o discreta.

- Sistemas abiertos y cerrados.

Un sistema cerrado es un sistema que intercambia señales solo a nivel interno, sin comunicación con el exterior. Suele presentar unos límites bien definidos, que actúan como fronteras, impidiendo la interacción con el entorno.

Un sistema abierto es el que tiene comunicación con el entorno mediante: a) unos receptores (dispositivos sensibles) que reciben señales del entorno y los transmiten al sistema; b) unos efectores que transmiten señales desde el sistema al entorno. Un ser humano es un sistema abierto, con los órganos de los sentidos como receptores y el habla, las expresiones faciales, el movimiento del cuerpo, etc., como efectores.

- Nivel de complejidad.

La complejidad de un sistema cibernético está determinado por la cantidad de relaciones entre sus elementos.

- Memoria.

Un sistema cibernético tiene memoria cuando puede acumular internamente información de alguna forma. Un sistema sin memoria simple es un timbre: al pulsar el botón, suena el timbre; la señal de entrada se convierte en una señal de salida, y el sistema no “recuerda” nada. Hay dos formas de memorizar la información: 1) mediante un cambio de estado; 2) mediante un cambio de la estructura del sistema. Puede haber una variante mixta.

- Tipos de cambio.

Hay dos tipos de cambio en el comportamiento de un sistema, dependiendo de la forma de “memorizar” la información: 1) auto-ajuste: el sistema cambia los valores de los parámetros esenciales; 2) auto-organización: el sistema cambia la estructura del sistema.

- Modelos.

Un modelo cibernético es una abstracción, una representación simplificada de un sistema en el que seleccionamos ciertas características e ignoramos otras, en función del objetivo que persigue el modelo construido por los creadores. Puede haber diferentes modelos posibles que consigan el mismo objetivo. Por lo tanto, hay que distinguir entre modelo cibernético y sistema cibernético. Podemos establecer entonces una analogía tipo Korzynski: el mapa no es el territorio y el modelo no es el sistema. Se suele decir que todos los modelos son siempre falsos porque la esencia del mundo real no se puede capturar. “Esencialmente, todos los modelos son erróneos, pero algunos son útiles” (George Box).

La cibernética de segundo orden

En 1972, la antropóloga Margaret Mead, presidenta de la American Society for Cybernetics (ASC), dedicó uno de sus discursos al tema “Cibernética de la Cibernética”. Heinz von Foerster [1974] sugirió cambiar este nombre por “Cibernética de segundo orden”. Hace referencia a la cibernética de los sistemas observantes, para diferenciarla de la cibernética de primer orden o cibernética de los sistemas observados (la cibernética de Wiener).

La cibernética tradicional (de primer orden) considera que la realidad es objetiva y existe independientemente del observador. La cibernética de segundo orden es de tipo reflexivo, incluye al observador, que se puede considerar un meta-sistema que observa, controla o interacciona con el sistema cibernético base. Un ejemplo de este tipo es un sistema social.

La cibernética de segundo orden está inspirada principalmente por los avances de la física moderna. A nivel cuántico, el observador influye o afecta a lo observado. Y a nivel relativista, el observador percibe según su sistema de referencia.

Los sistemas cibernéticos de primer orden no cambian sus objetivos mientras no se le den nuevas instrucciones al respecto, desde el exterior. Por ejemplo, un termostato (la orden externa es la fijación de una nueva temperatura). Los sistemas cibernéticos de segundo orden pueden modificar dinámicamente su objetivo, de forma autónoma.

También contribuyeron a cimentar este concepto Wittgenstein (filósofo y lógico), Warren McCulloch (neurofisiólogo), Gordon Pasq (psicólogo), así como Humberto Maturana y Francisco Varela (biólogos).

Para von Foerster [1974]:

- De todos los principios cibernéticos, uno ocupa el tema central, y es el de la circularidad. La circularidad es un concepto esencial, no solo para la cibernética, sino para la ciencia en general, la sociedad, las relaciones humanas, el aprendizaje, los procesos terapéuticos, la gestión de las organizaciones, etc. Representa una aportación epistemológica fundamental.

La circularidad, aparentemente viola el principio básico del discurso científico que demanda una separación entre conceptos opuestos o duales: causa y efecto, observador y observado, etc. En el caso del par observador-observado, la circularidad rompe el principio de objetividad (el observador es algo independiente de lo observado).

- La defensa tradicional de la objetividad se basa en el miedo a que surjan paradojas.

- Una “ciencia última”, descriptiva y objetiva del mundo, sin considerar los sujetos, conduce a contradicciones. Para eliminar estas contradicciones, hay que tener en cuenta al observador, que participa en lo observado.

- Las observaciones no son absolutas (objetivas), sino relativas al observador (subjetivas). Sin observador no hay observación. El observador y lo observado son inseparables.

- En cibernética resulta imposible acceder a un nivel superior al segundo, pues “cuando se reflexiona sobre la reflexión se cierra el circuito de argumentación y se produce la clausura organizacional, que solo puede trascenderse a sí misma dentro de sí misma”. Es decir, cuando se incluye el mecanismo de observación, se completa el ciclo y el mecanismo de observación se puede aplicar de forma recursiva.

La cibernética de tercer orden

A pesar de la afirmación anterior de von Foerster, algunos autores hablan de una cibernética de tercer orden, con dos características:

- Existe interrelación mutua entre el nivel base y el nivel meta, formando así una circularidad interactiva y una verdadera unidad superior. El observador y el sistema co-evolucionan. El observador debe cambiar su comportamiento para poder reconocer al sistema observado; si no cambia, dejará de reconocerlo.

- El sistema es consciente de su entorno y reconoce la forma de autorregularse para adaptarse a dicho entorno.

En la cibernética de segundo orden, hay causalidad desde el nivel meta hacia el nivel base. Con la cibernética de tercer orden se cierra el ciclo causal. Esto implica que el observador, no solo afecta o influye sobre lo observado, sino que lo observado hace cambiar al observador.

Un ejemplo de cibernética de tercer orden es una orquesta, en la cual cada músico no solo escucha su propio sonido sino el de todos sus compañeros, y adapta el propio en función de lo que escucha de sus compañeros.

La cibernética de los seres vivientes: autopoiesis

Los seres vivientes se pueden considerar sistemas cibernéticos cuyo objetivo es la estabilidad y la evolución, dentro de un entorno con el que interactúan.

Magoroh Maruyama [1963] (antes de la aparición del concepto de cibernética de segundo orden) afirmaba que los seres vivos se comportan como una ”segunda cibernética”. Todos los seres vivos dependen para su supervivencia de dos procesos: 1) Morfostasis, la retroalimentación negativa que tiende a estabilizarlo; 2) Morfogénsis, la retroalimentación positiva o amplificadora. Estos dos procesos se equilibran mutuamente.

El término “autopoiesis” es un neologismo creado en 1971 por Humberto Maturana y Francisco Varela (que describen en su obra “El árbol del conocimiento”). Proviene del griego: “auto” (sí mismo) y “poiesis” (creación o producción).

La autopiesis explica la organización de los sistemas biológicos, la capacidad distintiva que tienen los seres vivos de mantener y hacer evolucionar su propia organización interna, su estructura, de autoproducirse, de auto-regenerarse mediante una organización circular, auto-referencial o reentrante. Un sistema autopoiético se produce a sí mismo de forma continua usando recursos del entorno, de tal manera que el productor y el producto, el hacer y el ser, el sujeto y el objeto, son la misma cosa.

Los seres vivientes son seres autónomos autorreferentes. No todo ente autónomo es un ente vivo. La autorreferencia es un tipo de autonomía y es la que caracteriza a los seres vivientes. Los sistemas vivientes son simultáneamente sistemas autónomos y dependientes del entorno.

La teoría de la autopoiesis, aunque se apoya en la teoría cibernética, aporta dos importantes conceptos:

- Acoplamiento estructural.

Se refiere a la capacidad de un ser viviente de evolucionar, de reestructurarse, de cambiar constantemente su estructura de forma flexible y congruente con las modificaciones del entorno. Su dinámica estructural, sus posibles cambios estructurales están predeterminados. Hay determinismo estructural: lo que le pasa al ser vivo depende de su estructura. Este acoplamiento estructural circular, de dialogo constante ser-entorno, ocurre a múltiples niveles. “Los sistemas autopoiéticos no tienen inputs ni outputs. Pueden ser perturbados por acontecimientos independientes y sufrir cambios estructurales internos que compensen esas perturbaciones” [Maturana & Varela, 1980].

- Clausura operacional.

Los seres vivos son sistemas cerrados desde un punto de vista operativo o funcional. Para que la vida sea posible es necesario que el ser vivo se cierre ante el entorno, de tal manera que, ante la dinámica del entorno, se mantenga invariable su funcionalidad, su identidad, su autonomía, su totalidad. La clausura operacional se debe precisamente a su cualidad autorreferencial. El sistema nervioso del ser vivo tiene clausura operacional. “La circularidad de los sistemas vivos y sociales es efectivamente el hilo de Ariadna que permite comprender su capacidad para la autonomía” (Francisco Varela).

Es decir, los seres vivos son estructuralmente abiertos y funcionalmente cerrados.

- La organización es la esencia de la vida. Es el conjunto de las posibles relaciones de los procesos autopoiéticos de un organismo. Es su “espacio” autopoiético, su espacio de libertad.

- La estructura es lo accidental de la vida. Es la selección, en cada momento, de los conjuntos organizados para sustentar la funcionalidad.

- Cuando se produce una perturbación en el entorno, se produce un “acoplamiento estructural” que, manteniendo la organización, conduce a cambios estructurales para el restablecimiento del equilibrio homoestático.

Hay 3 tipos u órdenes de sistemas autopoiéticos: 1) las células; 2) los organismos (agregados celulares), que tienen sistema nervioso; 3) los agregados de organismos (familias, sociedades, colonias, colmenas, etc.), cuya característica principal no son sus componentes (los organismos), sino las relaciones entre ellos. Según Maturana y Varela [1980], el establecimiento de de un sistema autopoiético no es un proceso gradual; un sistema es autopoiético o no lo es.

A nivel fundamental, el objetivo de un sistema autónomo o autopoiético es la supervivencia, es decir, el mantenimiento de su organización esencial. Y hay objetivos subsidiarios como: mantener su temperatura, comer, etc. que contribuyen a su supervivencia.

Los sistemas artificiales, como un termostato o un piloto automático, son aparentemente autónomos, pero realmente no lo son pues su objetivo primario está implementado por sus diseñadores. Se dice que estos sistemas son “alopoiéticos”. Su función es producir algo distinto de sí mismo.

La auto-reproducción se puede considerar como un caso especial de autopoiesis, donde los componentes auto-producidos no son utilizados para regenerar el sistema, sino para formar una copia del mismo.

El concepto de autopoiesis ha desbordado los límites de la biología para aplicarse en otros dominios como sociología, antropología, psicoterapia, etc., habiéndose convertido en una cosmovisión, en un importante concepto para la investigación de la realidad y para modelar muchos tipos de sistemas. Por ejemplo, el sociólogo Niklas Luhman [1996] lo ha aplicado al estudio de sociedades en contextos de contingencia y riesgo. La pretensión de Luhman es crear una superteoría aplicable a todo fenómeno social. Su obra actual se considera uno de los estudios teóricos más importantes elaborados en el campo de la sociología. Puntos destacados son:

- La sociedad es un sistema autopoiético, es decir, es autónoma y funciona gracias a la producción de sus propios componentes. Es autónoma, no solo en el plano estructural, sino también en el plano del control de la organización de sus estructuras.

- La socialización es posible porque surge una forma emergente, un nuevo orden de realidad: una red cerrada (autopoiética) de comunicación. Las comunicaciones se producen en el interior del sistema. La sociedad es una red de comunicación cerrada operacionalmente y autorreferente.

- La comunicación es el acoplamiento estructural y nos hace mantener la organización social. La civilización es la consecuencia de la comunicación.

- Los sistemas sociales son sistemas determinados estructuralmente.

- Los seres humanos son seres dependientes de la red emergente de tipo superior, que es la sociedad.

Sin embargo, Varela rechazó que los conceptos autopoiéticos se pudieran aplicar a los sistemas sociales, restringiéndolo exclusivamente a los sistemas biológicos.

La mente, un sistema cibernético

Según Gregory Bateson [1993, 2002], la mente es un sistema cibernético: un agregado de de partes interactivas que exhiben una estructura de realimentación. Según este autor, donde hay realimentación hay mente. La complejidad de sistemas con realimentación (y, por lo tanto, con mente) varía desde un simple termostato hasta la mente humana y más allá: la mente universal. La mente individual es solo un subsistema de la mente universal. También hay una mente en el sistema social y en la ecología planetaria.

Bateson habla de una “ecología de la mente”, donde existe un “patrón que conecta” mente y naturaleza, lo interior y lo exterior. Este patrón que conecta es un meta-patrón, un patrón de patrones que elimina la dicotomía entre mente y naturaleza.

La Valoración de la Cibernética

La cibernética, ¿ciencia universal?

Muchos autores consideran que la cibernética es una ciencia universal o una ciencia interdisciplinaria o transdisciplinaria, pues los sistemas cibernéticos se encuentran en todas las áreas de conocimiento. El propio Wiener afirmó en su obra seminal de 1948 que “las más fructíferas áreas para el desarrollo de las ciencias eran aquellas que habían sido olvidadas como tierra de nadie entre varios campos establecidos”.

- La cibernética se considera una ciencia crucial relacionada con una gran multitud de campos, una ciencia con frontera difusa o estrechamente relacionada con otras como: Matemáticas, Informática, Lógica, Teoría de la Información, Teoría de Autómatas, Teoría de Control, Teoría de Lenguajes Formales, Inteligencia Artificial, Teoría General de Sistemas (TGS), Investigación Operativa, Teoría de la Complejidad, Dinámica de Sistemas, Teoría de la Decisión, Teoría de optimización de Procesos, Teoría de Reconocimiento de Patrones y Aprendizaje Automático, Teoría de la Organización, Teoría de Redes Neuronales Artificiales y Teoría del Caos. Muchos autores consideran que algunas de estas disciplinas son realmente ramas de la cibernética. De todas estas disciplinas, la Teoría General de Sistemas es la más vinculada a la cibernética, hasta tal punto que muchos autores consideran estas dos disciplinas como inseparables.

La cibernética ha tenido una gran influencia en el nacimiento de algunas de estas ciencias, en especial Informática, Inteligencia Artificial, Teoría de Control, Teoría de Autómatas, Teoría de la Complejidad, Dinámica de Sistemas, Robótica y Biónica.

Muchos conceptos centrales de estas ciencias fueron explorados primeramente por los cibernéticos, como: complejidad, auto-organización, autonomía, auto-reproducción, adaptación, etc.

- Otras disciplinas que pueden contemplarse bajo el paradigma cibernético son: Neurociencia, Biología, Psicología, Sociología, Ciencia Cognitiva, Antropología, Teoría de Juegos, Filosofía y Teoría de la Organización.

Wiener era firme partidario de la aplicación de la cibernética a las ciencias sociales. Estaba convencido que el comportamiento humano de animales y máquinas podía explicarse aplicando los principios de la cibernética. Popularizó las implicaciones sociales de la cibernética estableciendo analogías entre sistemas automáticos e instituciones humanas en su segunda obra “The Human Use of Human Beings. Cybernetics and Society” (El uso humano de seres humanos. Cibernética y sociedad).

- Otros autores ven la cibernética, no como una ciencia, sino como un conjunto de ideas generales que tratan de romper las rígidas fronteras de las diferentes disciplinas. De hecho, a pesar de su histórico papel de pionero en muchos temas, la cibernética nunca se estableció como una disciplina autónoma. Sin embargo, se considera una especie de “ciencia madre”.

- A causa de su generalidad, la cibernética se ha considerado como una especie de panacea, una forma privilegiada de contemplar el mundo. Incluso se consideró una motivación para el comunismo: cómo gobernar el mundo de forma óptima. También se le ha considerado una nueva filosofía.

- La aparición de la cibernética tuvo una gran repercusión. Durante los años 1950s y 1960s muchas ciencias se replantearon sus propios fundamentos a la luz de los principios cibernéticos. Muchos libros de divulgación de la cibernética representaban la palabra “cibernética” en el centro de un círculo y las otras disciplinas alrededor, simbolizando el papel central de la cibernética en las ciencias. En esos libros se mostraba que, a pesar de sus diferencias aparentes, todo (respirar, cocinar, pintar, educar, etc.) podía ser explicado mediante los principios cibernéticos, que eran principios universales. La cibernética parecía poder lograr el proyecto utópico de relacionar todo el conocimiento disperso en una ciencia universal, interdisciplinaria o transdisciplinaria.

A mediados de los años 1970s, la gran ola de publicaciones cibernéticas experimentó un brusco descenso por el gran éxito de la Informática, que no cumplía el sueño teórico de la unidad del conocimiento, pero que aportaba una herramienta universal práctica para el procesamiento de la información: el ordenador digital, basado en la máquina universal de Turing. La Informática sustituía el conocimiento por la información, un concepto de menor nivel de abstracción pero más manejable y práctico.

- Durante los años 1950s muchos cibernéticos se unieron a la Teoría General de Sistemas (TGS), fundada por la misma época por Ludwig von Bertalanffy, en un intento de construir una ciencia unificada mediante el establecimiento (o descubrimiento) de unos principios generales o universales que gobiernan todos los sistemas, naturales y artificiales. Mientras los sistemas cibernéticos estudian los sistemas autorregulados y orientados a un objetivo, la TGS estudia todo tipo de sistemas generales. Ambas ciencias (cibernética y TGS) se pueden considerar como intentos de creación de una ciencia transdisciplinaria basada en el concepto genérico de sistema.

Lo que sí puede afirmarse de la cibernética es lo siguiente:

- Los principios de la cibernética son tan generales que esta ciencia tiene potencialmente una aplicación universal, habiendo contribuido en gran medida a mejorar nuestra comprensión de la realidad. Se pueden aplicar para entender, modelar y diseñar sistemas de cualquier tipo, Se puede aplicar a sistemas animados (seres vivientes) y no animados (sistemas automáticos), a la economía, a la psicología, a los sistemas físicos y sociales, etc. La cibernética se puede aplicar a la naturaleza, pues todo en ella consta de procesos autorreguladores, incluso en el reino mineral también se han descubierto procesos de este tipo.

Estos conceptos generales son de tipo teórico y no están condicionados por la forma de implementación física (electrónica, mecánica, etc.) concreta o de sus componentes materiales. Esta característica es lo que permite modelar sistemas muy diferentes. “Las ideas básicas de la cibernética pueden encararse sin ninguna referencia a la electrónica y son fundamentalmente simples” (William Ross Ashby). En este sentido teórico, se puede establecer la analogía: la cibernética es a los sistemas como la geometría es a los objetos materiales. La cibernética es una ciencia general y abstracta de los sistemas.

La cibernética demostró que las barreras existentes entre las diferentes disciplinas eran superables porque existían muchas analogías y semejanzas a nivel abstracto. Ciencias aparentemente distantes como la matemática, la biología y la electrónica podían contemplarse unidas desde la perspectiva superior de la cibernética.

- La cibernética es una ciencia simple para tratar lo complejo (a nivel estructural y funcional) y que su ámbito de estudio son todos los sistemas posibles. Permite abordar antiguos problemas de una manera más simple, al disponer de recursos conceptuales genéricos y potentes. El paradigma cibernético ofrece nuevas intuiciones y nuevas perspectivas para investigar la realidad y para modelizar sistemas.

Filosofía de la cibernética

Aparentemente, la cibernética, al adoptar un enfoque científico y mecanicista en todos los dominios (incluidos los sociales), se podría interpretar como un intento de eliminar la filosofía, como ocurrió con el positivismo a partir de Comte, que fundamentaba el conocimiento en el empirismo y el verificacionismo científico.

Heidegger en “El final de la filosofía y la tarea del pensar” (1964) ataca a la cibernética como la consumación del pensamiento técnico y superficial de la modernidad, con el consiguiente olvido del ser. Reclama un tipo más profundo de pensamiento y la búsqueda del ser que se oculta tras todos los entes. E ironiza: “Mientras la filosofía clásica se desvanece, la cibernética se convierte en una filosofía para el siglo veinte”.

Wiener, que estudió filosofía, insistía en la necesidad de una filosofía cibernética. Y, en efecto, la Cibernética plantea una serie de problemas filosóficos, entre ellos los siguientes:

- Lo principios.

Los principios cibernéticos son muy generales o universales. La filosofía se interesa por lo universal, por los principios fundamentales de la realidad.

- Epistemología.

La cibernética aporta una epistemología, una teoría del conocimiento, fundamentada en la sustitución de lo “real” por lo abstracto. La filosofía pretende aprehender la verdadera esencia de la realidad y así lograr la unificación del conocimiento.

- La relación hombre-máquina.

La cibernética trata de sistemas autónomos, que toman sus propias decisiones, incluso que aparentemente “piensan”. La filosofía es especulativa, por lo que nos preguntamos: ¿pueden pensar las máquinas?, ¿es el hombre una máquina o una de las posibles implementaciones de un sistema cibernético?, ¿puede ayudarnos la cibernética a entendernos mejor nosotros mismos?, ¿llegarán las máquinas a dominar el hombre?, etc.

Cibernética y conciencia

La cibernética es una notable aproximación al tema de la conciencia, al unir toda una serie de opuestos:

- Entrada y salida. En la retroalimentación, la salida (o parte de ella) se convierte en entrada.

- El sistema y su entorno, lo interno y lo externo, lo activo (el sistema) y lo pasivo (el entorno), lo subjetivo y lo objetivo, lo lineal y lo circular, el observador y lo observado, el ser y el hacer, el productor y el producto.

- El análisis y la síntesis, el reduccionismo y el holismo.

- El estado inicial y el estado-objetivo final. Un sistema cibernético busca desde su inicio el estado final, el estado de equilibrio, uniendo así el comienzo y el final. El estado final (el propósito) está asociado al futuro (la conciencia sintética) y el estado inicial está asociado al pasado (la conciencia analítica).

- Lo general y lo particular. Los conceptos cibernéticos son tan generales que pueden aplicarse a muchos sistemas particulares.

- Lo animado y lo inanimado. Los principios cibernéticos intentan capturar lo común a ambos reinos.

- El controlador y lo controlado.

- El receptor y el efector (percepción y acción).

- La retroalimentación positiva y la negativa en los seres vivientes y en muchos sistemas que buscan el equilibrio.

- La autonomía y la dependencia del entorno.

- La conservación y la evolución.

- La teoría y la práctica.

- La libertad y el determinismo.

- Lo simple y lo complejo.

- La mente y el cuerpo.

- Lo individual y lo social.

- El idealismo y el realismo.

- Lo temporal y lo atemporal.

- Lo digital y lo analógico.

Es una paradoja, no concebible con el pensamiento tradicional de tipo dicotómico (verdadero/falso, sí/no, etc.), sino con un modelo de pensamiento en el que se compatibiliza el pensamiento analítico con el sintético, lo lineal con lo circular, etc. En definitiva, con la unidad de los opuestos. Esta dialéctica de los contrarios está en la base de la conciencia y la vida. La circularidad, pese a ser un concepto esencial, no más que un caso particular del concepto general de “unión de opuestos”.

Gregory Bateson [1993] consideraba a la cibernética una disciplina clave, muy importante: “Pienso que la cibernética es el mayor a la fruta del árbol del conocimiento que la humanidad ha dado en los últimos 2000 años”. Pero ahora podemos comprender mejor su importancia por su estrecha relación con el tema de la conciencia.

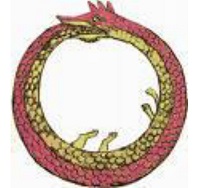

El símbolo que mejor representa la unión de los opuestos es el Ouroboros, la mítica serpiente que engulle su propia cola, formando así un círculo. El circulo, no teniendo ni principio ni fin, es el símbolo de Dios, del alma, de la conciencia, de lo absoluto, de la eternidad, de la perfección, de la totalidad indivisible, de la unidad, de lo inmutable, de la esencia indestructible y de la permanencia de todas las cosas. Y la serpiente simboliza:

- La conciencia, representada por la unión de los opuestos para formar una unidad de orden superior.

- La retroalimentación, la autorreferencia, la identidad sin fin.

- La naturaleza cíclica de las cosas, que nunca desaparecen sino que cambian de forma perpetua en un ciclo eterno de creación y destrucción. Es el eterno retorno y la continuidad de la vida, la auto-regeneración, la renovación y la evolución.

|

| Ouroboros

|

En algunas representaciones la serpiente se representa con una mitad clara y otra oscura, haciendo a la vez referencia a la dicotomía de los procesos cíclicos (día-noche, etc.).

La problemática de la cibernética

La cibernética arrastra una cierta problemática, por lo que ha sido criticada, e incluso cuestionada, por diferentes razones:

- Por carecer de principios perfectamente claros y coherentes. La generalidad y nivel de abstracción de sus conceptos son, a menudo, ambiguos. De ahí la variedad de definiciones antes apuntadas. Pero, según von Foerster [1995], éste es un aspecto positivo: “Esto se debe a la riqueza de su base conceptual, y yo creo que esto es bueno, pues de otra forma la cibernética se convertiría en un aburrido ejercicio”.

- Por su frontera difusa con muchas disciplinas.

- Por tomar prestadas muchas ideas de la matemática, la biología y la electrónica.

- Porque existe una cierta confusión e indefinición de los niveles cibernéticos.

- Porque muchas disciplinas que la cibernética inspiró (como la Informática y la Inteligencia Artificial) experimentaron una rápida evolución, se declararon independientes olvidaron su origen, lo que ha contribuido a vaciar de contenido la cibernética. Incluso la Robótica se considera una ciencia independiente.

- Por estar limitada solo a especialistas, por lo que no se ha hecho popular.

- Porque el prefijo “cib” o “ciber” (en inglés “cyb” o “cyber”) aplicado a un híbrido entre robot y ser vivo (cyborgs) y a Internet (ciberespacio) ha hecho diluir su significado. El término “ciberespacio” fue introducido por William Gibson en su novela de ciencia ficción "Neuromancer" (Neuromante).

- Por último, y más importante, por carecer de un lenguaje formal. El propio Wiener afirmó que “Es el propósito de la cibernética desarrollar un lenguaje y técnicas que nos permitirán atacar de verdad el problema de control y comunicación en general”. Bateson afirmaba que era esencial la creación de un nuevo lenguaje que permitiera expresar los conceptos de la cibernética.

El lenguaje cibernético debe permitir representar todo el conocimiento: la comunicación, el control, la realimentación, la información, etc.

El lenguaje es el elemento unificador de todo, no solo de la cibernética, sino de todas las ciencias formales, incluyendo la Informática y la Inteligencia Artificial.

Pero hoy día no existe ese lenguaje estándar capaz de modelar los sistemas cibernéticos. Se suelen utilizar las matemáticas, los lenguajes de programación, lenguajes de simulación, etc.

Cibernética vs. Inteligencia Artificial

La cibernética y la Inteligencia Artificial se han disputado la construcción de sistemas inteligentes. El movimiento cibernético empezó primero (1948, con Wiener), siendo su época dorada los años 1950s. La Inteligencia Artificial (IA) nació oficialmente en 1956 en la famosa Conferencia del Dartmouth College (Hanover, New Hampshire) y dominó principalmente entre 1960 y 1985.

- La IA se centró principalmente en la analogías o metáforas cerebro-hardware y mente-software, es decir, la mente/cerebro como procesador universal de información. El hardware basado en la electrónica digital y el software basado en el concepto de información.

- La cibernética puso más énfasis en la analogía entre sistemas biológicos y máquinas autónomas, especulando sobre si algún día dominarían al hombre.

Sin embargo, la frontera entre cibernética e IA es difusa. Por ejemplo, cuando un sistema reacciona adecuadamente con su entorno, emerge la ilusión de inteligencia.

Además, por la problemática descrita anteriormente, muchos autores e investigadores han propuesto que sea la IA la ciencia que se dedique a la teoría y al desarrollo de sistemas que tengan comportamientos inteligentes. De hecho, los congresos de cibernética se han convertido en la práctica en congresos de IA. Sin embargo, alrededor del año 2000, se produjo un movimiento de retorno a la cibernética, principalmente por 3 razones:

- Por la necesidad de disponer de un marco conceptual de tipo general, integrador o unificador para toda una serie de disciplinas más o menos dispersas.

- Por los repetidos fracasos de la IA, que ha decepcionado las grandes expectativas puestas en ella.

- Porque un sistema de IA profunda requiere interacción con su entorno, por lo que necesitamos una “IA cibernética”.

Sin embargo, actualmente los objetivos de la IA y la cibernética están cada vez más próximos, hasta tal punto que tienden a confundirse. A veces, incluso las siglas AI (Artificial Intelligence) se interpretan como Agent Intelligence o Agent Intelligence.

Cibernética e informática

Actualmente, la informática se ha convertido en el recurso técnico más útil para investigar y desarrollar modelos cibernéticos, tanto reales como simulados. De hecho, la evolución de la cibernética (como la Inteligencia Artificial) se debe, en gran parte, a los ordenadores y a sus programas de simulación. El propio ordenador es un sistema cibernético, y por lo tanto es objeto de investigación por parte de la cibernética. Es paradójico que para investigar los sistemas cibernéticos se utilice un sistema cibernético como es el ordenador. Pero el ordenador es realmente una meta-máquina, una máquina capaz de ser configurada como cualquier máquina particular.

Los programas de simulación (como Simula, Simscript, Slen, Nedis, etc.) utilizan un lenguaje diferente cada uno. Y un sistema informático también requiere un lenguaje. Y aquí tenemos una brecha (gap) semántica, una brecha semántica entre ambos lenguajes. De todas formas, existen traductores que convierten la descripción de un sistema cibernético a código de ordenador.

MENTAL, un Lenguaje para la Cibernética

La cibernética ha tenido un gran impacto precisamente por su estrecha relación con el tema de la conciencia, por la unión de opuestos. Pero carece de un lenguaje formal capaz de expresar sus conceptos fundamentales.

MENTAL es un lenguaje universal fundamentado en la conciencia, en la unión de opuestos que puede aplicarse a la cibernética, pues permite expresar e implementar fácilmente la retroalimentación, la comunicación con el entorno y la autorregulación, incluyendo la modificación de su propia estructura. MENTAL está en un nivel de abstracción superior a la cibernética, por lo que ésta no es más que una aplicación de MENTAL. Además MENTAL, por su universalidad puede aplicarse también a la Informática y a la Inteligencia Artificial.

- Expresiones genéricas.

Con las expresiones genéricas se pueden expresar una red de relaciones (de dependencia e interdependencia) entre las variables (o expresiones en general) de un sistema, compartir elementos de diferentes sistemas, etc. El propio sistema cibernético está representado por una expresión genérica, que se evalúa indefinidamente, una vez tras otra. Es el “eterno retorno” filosófico y mítico. Cuando no hay variaciones en los parámetros de la expresión genérica, entonces se autoevalúa y el sistema cibernético alcanza la estabilidad.

Las expresiones genéricas tienen la ventaja de que no requieren autorrealimentación explícita, pues la repetición continua forma parte de su semántica.

- Entorno.

En MENTAL, el entorno es un sistema de almacenamiento, un sistema de comunicación, un sistema donde tienen lugar las interacciones. Todo está dentro del entorno. Sistema y entorno están unidos, constituyen una unidad.

- Comunicación.

Un sistema puede comunicarse e interactuar consigo mismo, con el entorno o con otros sistemas. La comunicación es algo de mayor nivel semántico que los clásicos mensajes de tipo lineal. Es un intercambio de significados realizados mediante la semántica de las primitivas. El contenido de la comunicación viene dado por los tipos de expresiones.

- Memoria.

Con MENTAL, las dos formas de acumular información (cambios de estado y de estructura) son esencialmente la misma.

- Sistemas abiertos o cerrados.

Desde el punto de vista de MENTAL, un sistema cibernético se compone de código (que forma su estructura) y de datos (internos o externos del entorno). Un sistema puede ser abierto o cerrado respecto al código o a los datos:

- Un sistema abierto respecto a los datos considera los datos del entorno (los datos internos siempre se consideran). Es lo que normalmente realizan los sistemas cibernéticos habituales. Si el sistema es cerrado respecto a los datos externos, solo considera los datos internos.

- Un sistema abierto respecto al código significa que el sistema puede cambiar su propio código para conseguir su objetivo. Si es cerrado, el código no cambia, su estructura es fija.

- Simplicidad.

MENTAL permite expresar fácilmente la complejidad mediante la simplicidad de las primitivas. Con MENTAL los desarrollos son más sencillos y permite especificar sistemas complejos con interacciones e interrelaciones de todo tipo.

- Cibernética unificada.

No hay una cibernética de primer orden ni de segundo orden ni de tercer orden. La cibernética debe ser auto-reflexiva. Solo hay una cibernética, que permite incluir siempre al observador y al observador del observador, etc. No hay límite en el número de niveles cibernéticos.

El modelo del observador está incluido en el modelo de lo observado porque comparten los mismos principios.

El observador puede ser un agente humano, otro sistema o el propio sistema (que se observa a sí mismo), que puede actuar y no ser solo un simple observador. Es una situación análoga a la de expresión y metaexpresión. lenguaje y metalenguaje, programación y meta-programación, etc., características que están incluidas en el lenguaje.

MENTAL permite desarrollar aplicaciones que se auto-observan o que se auto-controlan. Y considerar diferentes aspectos de los sistemas. La expresión genérica actúa como conciencia, como observador o controlador de la acción.

El sistema es capaz de modificar su propia estructura en función de las circunstancias del entorno para lograr su objetivo. Esto implica la existencia de meta-reglas que ajustan las reglas operativas, lo que supone un segundo bucle o lazo de retorno, esta vez a nivel estructural. Incluso puede haber meta-meta-reglas, lo que supondría un tercer lazo de retorno, y así sucesivamente. Este enfoque corresponde a los sistemas de orden superior (meta-sistemas, meta-meta-sistemas, etc.).

- Aprendizaje.

Con MENTAL se pueden desarrollar sistemas cibernéticos que aprendan, lo que implicaría la existencia de unas meta-reglas capaces de actualizar las reglas del nivel base y de generar nuevas reglas. Incluso puede haber aprendizaje del aprendizaje, etc. Cuanto mayor sea el número de niveles de meta-reglas, hay más abstracción y más conciencia (a nivel mental), pues aumenta la unión de opuestos.

- Grados de libertad.

Lo que muchos autores se plantean son los límites o grados de libertad que se pueden utilizar en el modelado de sistemas y, en definitiva, sobre los límites últimos del conocimiento y de lo expresable, a nivel transdisciplinario, de la ciencia en general y las limitaciones de la formalización de los modelos matemáticos e informáticos.

En esta cuestión lo que subyace es la búsqueda de un lenguaje universal que defina los conceptos universales y los límites de la expresividad formal. Un lenguaje que nos provea de un marco general que nos permita entender el mundo e integrar todas las ciencias dispersas.

En este sentido, MENTAL define los límites de lo expresable (a través de los grados de liberad que son las primitivas) y los sistemas posibles.

- La unión Cibernética – Inteligencia Artificial.

La solución a la dicotomía cibernética - Inteligencia Artificial es acudir a los arquetipos de la conciencia, donde reside la fundamentación común y profunda de ambas disciplinas.

- La unión Cibernética – Informática.

Con MENTAL se utiliza el mismo lenguaje en la cibernética y en informática. No hay que traducir el modelo a un lenguaje de programación. No hay gap semántico, pues MENTAL es un lenguaje de alto nivel de abstracción de tipo semántico. El modelo del sistema cibernético se implementa directamente en el ordenador como modelo de simulación o como modelo de producción. MENTAL se puede considerar un lenguaje universal de modelado.

- El modelo es la realidad.

Un modelo de un sistema cibernético es una abstracción. Cuando este modelo se realiza con recursos de máximo nivel de abstracción, estamos capturando su esencia. La esencia de un sistema no se encuentra en sus bloques constructivos físicos sino en sus constructos abstractos. Se produce entones una unión entre conocimiento interno (mente) y conocimiento externo (naturaleza), entre epistemología (lo que conocemos) y ontología (el objeto de conocimiento). Ambos conocimientos son la misma cosa porque comparten los mismos arquetipos de la conciencia. El modelo se convierte así en una representación real del sistema, de forma precisa, ideal, perfecta. A nivel profundo la realidad es abstracta. Por lo tanto, el modelo de la realidad es la propia realidad. Podemos entonces afirmar que el mapa es el territorio o, como dice Bateson, hay unión entre mente y naturaleza. El “patrón que conecta” mente y naturaleza lo podemos identificar como los arquetipos de la conciencia.

Los modelos MENTAL no son falsos, son verdaderos pues hacen referencia a la realidad profunda.

Pero como el mundo mental es más amplio y flexible (tiene más grados e libertad) que el mundo físico, podemos construir modelos solo a nivel mental en el que solo utilizamos los arquetipos primarios.

- Meta-modelo universal.

La cibernética se puede considerar como un intento de construir un metamodelo universal para construir modelos concretos. MENTAL es un meta-modelo universal, que representa a todos los posibles modelos (cibernéticos y no cibernéticos) que pueden construirse. La abstracción produce unidad y MENTAL es un marco unificador de máximo nivel de abstracción que trasciende a la cibernética.

- Más allá de de “la mente como sistema cibernético”.

La mente tiene aspectos cibernéticos, pero la calificación de “sistema cibernético” no captura su esencia. MENTAL va más allá, pues es un modelo de la mente. La realimentación no es un principio de la mente, sino una propiedad que emerge de los grados de libertad de la mente.

- Un ejemplo simple: Sistema de aire acondicionado.

tu= ... // temperatura fijada por el usuario

te= ... // temperatura exterior (del entorno)

ti= ... // temperatura interior

d=... // desviación máxima permitida en la temperatura interior

⟨( AireAcon(tu te ti d) =

((ti > te) → (ti-te > d) → Accion(Frio)

((ti < te) → (te-ti > d) → Accion(Calor)

)⟩

La expresión genérica se evalúa indefinidamente, y en donde:

Accion(Frio) es la acción de invocar al sistema energético para que baje la temperatura.

Accion(Calor) es la acción de invocar al sistema energético para que suba la temperatura.

Adenda

La ley de Ashby de la variedad requerida

Esta ley es quizás el principio cibernético más conocido, pues es muy simple e intuitivo: “Cuanto mayor es la variedad de acciones disponibles en un sistema de control, mayor es la variedad de perturbaciones que es capaz de compensar” o “Cuanto mayor es la variedad interna de un sistema de control, mayor es la adaptación a la variedad externa” o “Solo un incremento en la variedad interna puede absorber a la variedad externa”.

Es decir, un sistema de control puede controlar algo si tiene la variedad interna suficiente para representarla. Por ejemplo, si un sistema de control tiene que elegir entre dos alternativas, debe ser capaz de representar esas dos posibilidades al menos para poder realizar una distinción o selección.

Cibernética Organizacional

Es la aplicación de los principios de la cibernética a las organizaciones. Su principal promotor es Stafford Beer [1981, 1995]. Estudia principalmente el papel del diseño de los sistemas de información y los canales de comunicación en la consecución de los objetivos de las organizaciones. Su Modelo de Sistemas Viables (MSV) describe las condiciones necesarias y suficientes para que una organización sea viable y tenga un comportamiento flexible frente a entornos cambiantes y complejos, a partir de estructura, actividades, interrelaciones y flujos de información. Y permite detectar “patologías” desde el punto de vista cibernético (estructurales, funcionales y los relacionados con los sistemas de información y comunicación). Un sistema viable debe tener 5 claves si quiere funcionar con eficacia en su entorno: práctica, coordinación, control, inteligencia y política.

Cibernética social y terapia sistémica

La cibernética social es un ejemplo de cibernética de segundo orden. Los cambios globales sociales provocan cambios en las conciencias individuales, que a su vez provocan cambios sociales.

Con la cibernética social surgen las terapias sistémicas, basadas en la retroalimentación y la comunicación humana en un entorno común. Se considera al paciente en su contexto social primario, la familia, que es un sistema de comunicación y de interrelaciones.

En general, los sistemas sociales pueden tener perturbaciones pero tienden al equilibrio, pues hay un “orden social” basado en reglas, normas y costumbres asociadas a su cultura.

Se abandona así el esquema tradicional de análisis de procesos internos, de tipo psíquico, y se sustituye por el análisis de los procesos de interacción comunicacional: el llamado “análisis sistémico”.

Gregory Bateson fue uno de los primeros en ver analogías entre un grupo familiar y un sistema cibernético. Provocó un giro epistemológico, una nueva forma de ver la realidad de una manera más global y sistémica, abriendo el campo hacia lo trans-personal y el trans-psiquismo.

Neocibernética

Aunque el término “Neocibernética” se ha aplicado a la nueva cibernética surgida con el concepto de autopoiesis de Maturana y Varela, Heikki Hyötyniemi [2006] lo utiliza para referirse a un nuevo marco teórico para la modelación y simulación de sistemas complejos, como los sistemas caóticos, los ecosistemas naturales, los sistemas económicos y los sistemas cognitivos (que son también sistemas cibernéticos). Este tipo de sistemas tienen 3 características esenciales: 1) no son centralizados; 2) no son lineales; 3) producen fenómenos “emergentes”, es decir, aparecen funcionalidades globales a partir de procesos simples de bajo nivel.

Se suele afirmar que los sistemas complejos desafían a todo intento de modelado, pues actúan de formas inesperadas, no previstas por los modelos. Sin embargo, la Neocibernética es una nueva forma de ver y modelar los sistemas cibernéticos complejos:

- Reconoce que para abordar sistemas complejos se necesitan conceptos y herramientas de alto nivel de abstracción.

- Busca un modelo universal, las leyes universales que gobiernan los sistemas cibernéticos, a pesar de la gran diversidad existente de este tipo de sistemas. Este modelo tiene que ser simple, siguiendo el principio de la navaja de Occam: los modelos más simples son los más correctos y adecuados. La simplicidad se interpreta a nivel matemático como linealidad.

- Pone el énfasis en el estado de equilibrio final (el estado emergente), más que en los procesos que conducen a dicho estado, procesos que son iteraciones no lineales. Este estado final es de equilibrio dinámico, es decir, es un estado de equilibrio entre las perturbaciones externas y las retroalimentaciones negativas que las compensan. Estos sistemas que tienen un estado de equilibrio dinámico (por ejemplo, entre orden y caos en el fractal de Mandelbrot) son los más interesantes.

- Pretende formalizar un concepto un tanto difuso como es la “emergencia”. Los estados emergentes (de alto nivel) se estudian directamente, en lugar de los principios generadores de bajo nivel de detalle. La autorregulación y la auto-organización emergen de las interacciones locales.

- En los sistemas lineales puede haber complejidad y producirse fenómenos emergentes, pues los sistemas complejos pueden ser el resultado de procesos secuenciales realizados por agentes (los constructores básicos) actuando de forma iterativa.

- Está orientado de forma explícita hacia el entorno del sistema, intentado capturar sus propiedades a partir de las respuestas del sistema. Esto se justifica porque un sistema es reflejo de su entorno.

- El estado final (de equilibrio) se puede caracterizar por ser el resultado de un proceso de optimización, de entropía máxima. La imagen del entorno es un modelo optimizado de las propiedades del entorno. Como no hay un control centralizado, las estrategias de optimización de la naturaleza están distribuidas en agentes locales.

- Se modelan los grados de libertad, más que las restricciones. Cuanto más complejo es un sistema, mayores son sus grados de libertad.

- Los estados emergentes de equilibrio dinámico, a los que se dirige el sistema como objetivo, se representan mediante patrones que son de tipo profundo, que es donde hay un mayor acoplamiento con el entorno. En cambio, la teoría tradicional de la complejidad está orientada a los patrones como manifestaciones superficiales (como el fractal de Mandelbrot, la concha marina de Wolfram y los mapas de Kohonen) que no reflejan la esencia del sistema.

- Para capturar los patrones emergentes se elimina el eje del tiempo para poder representar el estado final en equilibrio dinámico.

- Es un modelo equilibrado de equilibrios (un equilibrio de orden superior). Es un mapa o espectro de patrones de de los comportamientos relevantes de un sistema frente a su entorno, una colección de invariantes. Estos patrones son atractores. Y es un modelo basado en el mínimo local más que en el óptimo global.

- En el estado de equilibrio dinámico todos los nodos de la red son a la vez causas y efectos.

- La “vida universal” es un equilibrio dinámico de orden superior (equilibrio dinámico de equilibrios dinámicos). El objetivo de la vida es encontrar los grados de libertad y explotar esa variación mediante experiencias y observaciones.

Los fractales, sistemas autorreferentes

Los fractales poseen una propiedad cibernética: son sistemas autorreferentes, pues hacen referencia a sí mismos al contenerse a sí mismos. Los fractales también tienen relación con la conciencia al unir los opuestos de “parte” y “todo”. El fractal de Mandelbrot tiene la propiedad de que sus puntos están en el límite entre el orden y el caos. Son los puntos que convergen en la transformación recursiva (en el plano complejo)

La proporción áurea (Φ) es una expresión fractal porque se contiene a sí misma, es autorreferente. En MENTAL se expresa como

Su computación se dirige hacia un punto de equilibrio que nunca se alcanza porque es un número irracional. Pero desde el punto de vista descriptivo está perfectamente definida.

Otro número autorreferente es la raíz cuadrada de 2:

Bibliografía

- Bateson, Gregory. Una unidad sagrada. Pasos hacia una ecología de la mente. Gedisa, 1993.

- Bateson, Gregory. Mind and Nature. A Necessary Unity. Hampton Press, 2002.

- Couffignal, Louis. La Cybernétique. Presses Universitaires de France, Paris, 1963.

- Guillaumaud, Jacques. Cibernética y Lógica Dialéctica. Artiach editorial, 1971.

- Heylighen, Francis; Joslyn, Cliff. Cybernetics and Second-Order Cybernetics. Internet.

- Hyötyniemi, Heikki. Neocybernetics in Biological Systems. Helsinky University of Technology. Control Engineering Laboratory, Report 151, August 2006. Disponible en Internet.

- Luhman, Niklas. La ciencia de la sociedad. Anthropos/Universida Iberoamericana/Iteso, 1996.

- Maturana, Humberto; Varela, Francisco J. El árbol del conocimiento. Debate, 1996.

- Maturana, Humberto; Varela, Francisco J. Autopoiesis and Cognition. The Realization of the Living. Reidel, 1980.

- Maruyama, Magoroh. The Second Cybernetics. Deviation-Amplifying Mutual Causal Processes. American Scientist 5:2, pp. 164-179. 1963. Disponible en Internet.

- Ross Ashby, William. Introducción a la cibernética. Nueva Visión, Buenos Aires, 1960.

- Ross Ashby, William. Proyecto para un cerebro. El origen del comportamiento adaptativo. Tecnos, 1965.

- Ross Anderson, Alan (editor). Controversia sobre mentes y máquinas. Tusquets, 1984.

- Sapárina, Yelena. El hombre, animal cibernético. Planeta, 1972.

- Schrödinger, Erwin. ¿Qué es la vida? Tusquets, colección Metatemas, 2008.

- Shannon, Claude E.; Weaver, Warren. The Mathematical Theory of Communication. University of Illinois Press, 1998.

- Simon, Herbert Alexander. Las ciencias de lo artificial. Comares, 2006.

- Singh, Jagjit. Teoría de la información, del lenguaje y la cibernética. Alianza Universidad, 1972.

- Stafford Beer, Anthony. Brain of the Firm (The Managerial cybernetics of organization). John Wiley & Sons, 1981.

- Stafford Beer, Anthony. Decision and Control. The Meaning of Operational Research and Management Cybernetics. John Wiley & Sons, 1995.

- Varela, Francisco. Principles of Biological Autonomy. Elsevier, 1979.

- von Foerster, Heinz. Cybernetics of Cybernetics. Or the Control and the Communication of Communication. Biological Computer Laboratory, 1974.

- von Foerster, Heinz. Las semillas de la cibernética. Obras escogidas. Gedisa, 1991.

- von Foerster, Heinz. Understanding Understanding. Essays on Cybernetics and Cognition. Springer, 2010.

- von Foerster, Heinz. Ethics and second-order cybernetics. SEHR, vol. 4, issue 2: Constructions of the Mind, 1995. Disponible en Internet.

- Watzlawick, Paul. Teoría de la comunicación humana. Interacciones, patologías y paradojas. Herder, 2008.

- Wiener, Norbert. Cibernética. Guadiana de Publicaciones, 1960. Traducción de la obra “Cybernetics, or control and communicacations in the animal and the machine”.

- Wiener, Norbert. The Human Use of Human Beings. Cybernetics and Society. Da Capo Press, 1988.

- Wiener, Norbert. God and Golem, Inc. A Comment on Certain Points where Cybernetics Impinges on Religion. The MIT Press, 1966.

- Wiener, Norbert; Schadé, J.P. Sobre modelos de los nervios, el cerebro y la memoria. Tecnos, 1969.